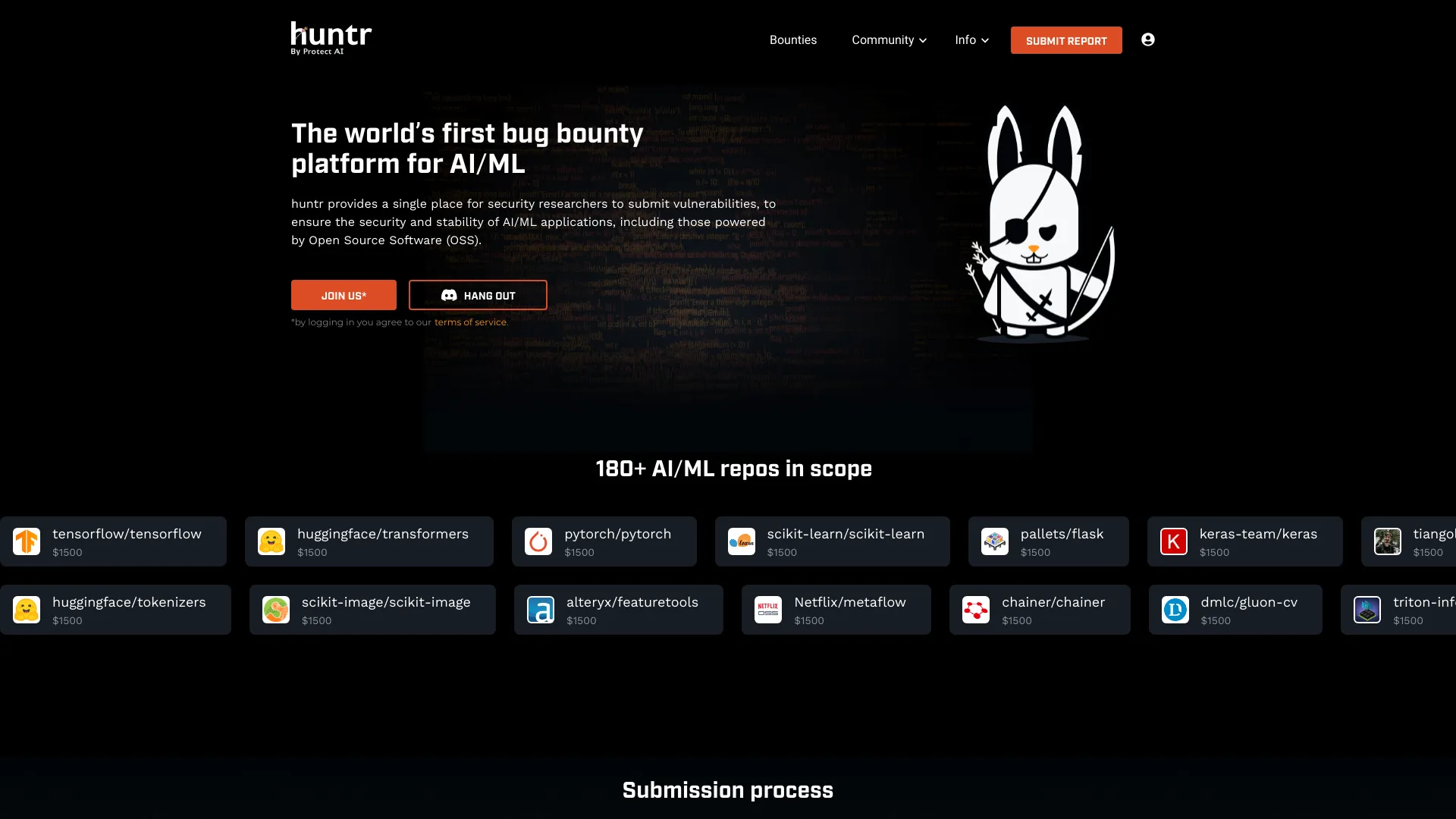

huntr

详细说明

huntr:AI/ML开源项目的安全守护者

引言

在人工智能和机器学习技术蓬勃发展的今天,开源项目作为创新的重要推动力,其安全性问题日益凸显。huntr作为全球首个专注于人工智能/机器学习开源应用程序、库和模型文件格式的漏洞赏金平台,致力于构建一个更安全的AI生态系统。该平台连接了全球安全研究人员与AI/ML开源项目维护者,通过协作发现并修复潜在安全漏洞,保护用户免受潜在威胁。

功能特性

huntr平台提供了一系列针对AI/ML安全的专业功能,使其在漏洞赏金领域独树一帜:

| 功能类别 | 具体描述 |

|---|---|

| 漏洞管理 | 提供完整的漏洞生命周期管理,从提交、验证到修复和奖励发放 |

| 项目支持 | 覆盖主流AI/ML框架、库和模型格式,如TensorFlow、PyTorch、ONNX等 |

| 激励机制 | 根据漏洞严重性和影响力提供差异化赏金,激励高质量漏洞发现 |

| 社区协作 | 建立开发者、研究人员和项目维护者之间的安全社区 |

| 教育资源 | 提供AI/ML安全学习材料和最佳实践指南 |

使用方法

参与huntr平台非常简单,无论是项目维护者还是安全研究人员,都能快速上手:

注册与认证:访问huntr官网,创建账户并完成身份验证

项目参与:

- 项目维护者:提交开源项目,设定漏洞范围和赏金预算 - 研究人员:浏览受支持的项目列表,选择感兴趣的目标

漏洞提交:发现漏洞后,通过平台提交详细报告,包括复现步骤和影响分析

验证与修复:项目维护者确认漏洞有效性,进行修复并更新代码

赏金发放:漏洞修复后,平台根据预设标准向研究人员发放赏金

应用场景

huntr平台适用于多种AI/ML安全相关场景:

- 开源项目安全加固:帮助AI/ML开源项目在发布前发现并修复潜在漏洞

- 企业AI系统安全:企业可基于平台发现的漏洞,评估自身AI系统的安全风险

- 安全研究:为研究人员提供合法、受控的环境来探索AI/ML安全问题

- 安全人才培养:通过实践参与,培养更多AI/ML安全专业人才

技术特点

huntr平台的技术架构和特点使其能够高效处理AI/ML领域的特殊安全挑战:

- 专业化分类:针对AI/ML特定漏洞类型(如模型窃取、对抗性攻击、数据投毒等)建立分类体系

- 自动化验证:集成自动化工具辅助初步漏洞验证,提高处理效率

- 跨平台支持:支持多种操作系统和编程环境下的漏洞检测

- 隐私保护:确保漏洞信息在修复前的保密性,防止恶意利用

- 智能匹配:根据研究人员专长和项目需求进行智能匹配,提高漏洞发现效率

问题与解答

Q1: huntr与传统漏洞赏金平台有何区别? A1: huntr专注于AI/ML领域的安全问题,具有更强的专业性。传统平台通常覆盖广泛的软件类型,而huntr深入针对机器学习框架、模型文件格式等特定领域的漏洞,拥有专门的评估标准和分类体系。此外,huntr社区聚集了对AI/ML安全有深入了解的研究人员,能够发现更隐蔽、更专业的安全漏洞。 Q2: 参与huntr需要哪些技能背景? A2: 参与huntr需要结合安全研究和AI/ML知识。理想参与者应具备:基础的软件安全测试能力、对常见漏洞类型的理解、至少一种主流AI/ML框架(如TensorFlow或PyTorch)的使用经验、模型文件格式的了解,以及基本的编程能力。对于初学者,huntr提供学习资源帮助快速入门,社区也欢迎不同水平的研究人员参与贡献。